生成AIの急速な発展により、企業のAI活用への期待はかつてないほど高まっています。

その活用は企業の競争力を左右する一方で、AIリスクへの対応が急務の課題となっています。

AIがもたらす恩恵は計り知れない反面、決定プロセスの不透明さや意図せぬ判断の偏り(バイアス)によるリスクなど、解決すべき問題も少なくありません。

本記事ではAIガバナンスのあり方や重要性に触れ、自社でAIを活用する際のリスクマネジメント指針の策定に役立つ知見を紹介します。

具体的には、以下の3つのポイントについて理解を深めることができます。

| ★まとめ ・AIガバナンスの基本的な定義と、現代のビジネスで求められる理由 ・AIガバナンスを導入することで企業が得られる具体的なメリットと、実践上の課題 ・リスク分析から改善まで、AIガバナンスを自社で構築するための実践的プロセス |

★生成AIのセキュリティリスクについて詳しくはこちら

目次

AIガバナンスとは

ビジネスにおけるAI活用が広がる今、「AIガバナンス」の重要性が増しています。

これは単なる技術用語ではなく、AIがもたらすリスクを管理し、企業の信頼を守るための経営課題そのものです。

本章では、まずAIガバナンスの正確な定義と、それが求められる社会的背景について解説します。

AIガバナンスとは

AIガバナンスとは、企業や組織がAI(人工知能)を開発・運用・利活用する際に、そのプロセス全体を適切に管理・統制するための仕組みや体制を指します。

いわば「AIを安全かつ有効に活用するための社内ルールブック」のようなものと考えると分かりやすいでしょう。

その目的は、AIがもたらすリスクを最小限に抑えつつ、メリットを最大限に引き出すことです。

そのためには、明確なポリシーや倫理指針を策定し、遵守できる組織体制を築く必要があります。

この取り組みには、AIの意思決定における公平性や透明性の確保、プライバシー保護、セキュリティ対策、法令遵守(コンプライアンス)など、幅広い視点が含まれます。

まさにビジネスの根幹に関わるテーマであり、経営レベルでの取り組みが不可欠だと言えるでしょう。

AIガバナンスが求められる背景

AIガバナンスが強く求められるようになった背景には、AI技術の飛躍的な進化と社会への急速な浸透があります。

特に2022年11月に登場したChatGPTが大きな注目を集めたことで、2023年以降、簡単な指示(プロンプト)で文章や画像を自動的に作り出す生成AIが社会へ急速に普及しました。これにより、ビジネスにおけるAI活用の可能性は大きく拡大しました。

しかしその一方で、AIが生成する出力の信頼性や、学習データに含まれるバイアスに起因する差別的な判断、著作権や個人情報の侵害といった、新たなリスクも浮上しています。

社会がAIの利便性を享受すればするほど、その負の側面への懸念も高まります。そのため、事業者にはAI技術を適切に管理し、社会的信頼を損なわないための自主的なルール作りと、その実践体制の整備が求められるようになりました。

★生成AIについて詳しくはこちら

➡︎【資料ダウンロード】AI時代の未来を拓くAIエージェント導入の重要ポイント

AIガバナンスが重要な理由

AIガバナンスの確立は、単なるリスク回避のための守りの施策にとどまりません。

それは、顧客や社会からの信頼を獲得し、持続的な企業成長を実現するための攻めの戦略とも位置付けられます。

AIの判断が人々の生活やビジネスに大きな影響を与えるようになった現在、そのプロセスが倫理的かつ公平であることが強く求められています。ここではまず、企業活動の基盤となる「守り」の側面からその重要性を解説し、続く章で「攻め」のメリットを詳しく見ていきましょう。

倫理・透明性・公平性の確保

AIのアルゴリズムは複雑であり、その判断プロセスが「ブラックボックス」化しやすいという特性を持ちます。

ブラックボックスとは、内容構造や動作原理が不透明な状態を表す言葉ですが、AIにおいても、「なぜAIがその結論を出したのか」という理由や過程が、人間には分からなくなってしまう状態のことを指します。

たとえば、AIが採用候補者や融資申請者に不当な評価を下した場合、その判断根拠を説明できなければ、企業は深刻な倫理的問題に直面し、ステークホルダー(企業活動に関わる人々)からの信頼を失いかねません。

AIガバナンスは、この状況を防ぐために重要な役割を果たします。

学習に用いるデータに偏りがないか、アルゴリズムが特定の属性を持つ個人を不利益に扱っていないかを検証し、公平性を担保する基準の設定が求められます。

また、AIの判断理由や根拠を可能な限り説明できるようにし、透明性を高める取り組みも欠かせません。

著作権やプライバシーなど法的リスクへの対応

AIの活用は、著作権やプライバシー保護といった法的な論点と密接に関わっています。

たとえば、生成AIが膨大な学習データからコンテンツを生成する過程で、著作権で保護されたものを意図せず利用してしまうリスクが指摘されています。

また、顧客の個人情報をAI分析に用いる際は、個人情報保護法などの法律を厳格に遵守しなければなりません。

AIガバナンスを整備することで、AI開発・利用の各段階で法的要件を確認するプロセスを導入できます。

これにより、法令遵守違反による罰金や訴訟といった経営リスクを未然に防ぎ、企業の法的安定性を高めることにつながります。

➡︎【資料ダウンロード】AI時代の未来を拓くAIエージェント導入の重要ポイント

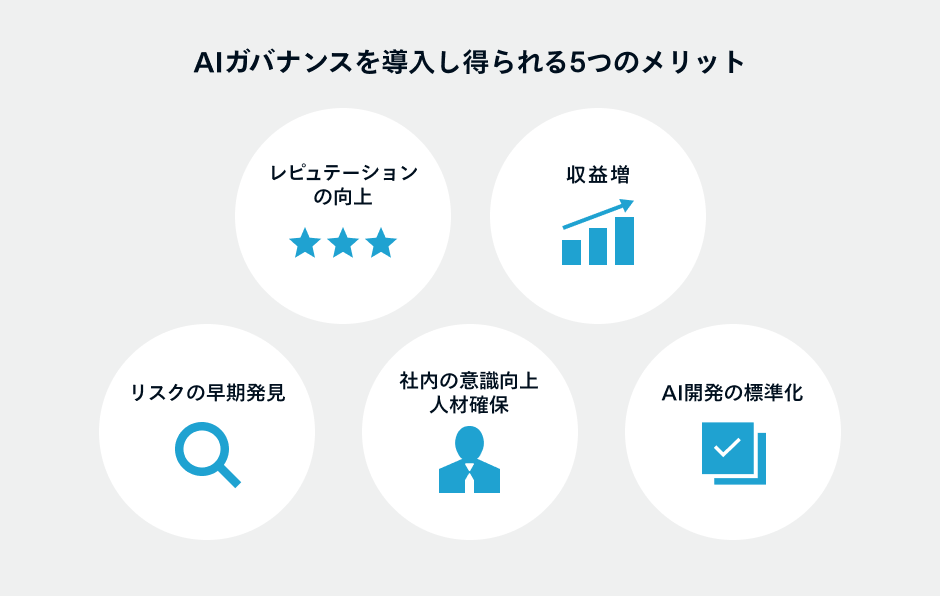

AIガバナンスを導入し得られる5つのメリット

AIガバナンスは、リスク管理という「守り」の側面だけでなく、企業価値を向上させる「攻め」の経営にも直結します。そこで、AIガバナンスの導入によって企業が得られる5つの具体的なメリットを紹介します。

1.レピュテーションの向上

「責任あるAI」への取り組みは、企業の評判(レピュテーション)を大きく向上させます。

顧客や投資家は、AIリスクを適切に管理する誠実な企業を高く評価するためです。

ガバナンスを通じて安全なAI活用を示すことが、社会からの信頼や強固なブランドイメージの構築につながります。

2.収益増

AIガバナンスは、間接的に企業の収益増にも貢献します。

ガバナンス体制によってAIの品質や信頼性が確保されることで、製品やサービスの競争力が高まり、顧客満足度の向上にもつながります。

また、AIの誤作動による事業機会の損失といったリスクを抑えることで、安定した事業運営の基盤作りにもつながるでしょう。

3.リスクの早期発見

リスクを早期に発見できる点も大きなメリットです。

AIのライフサイクル全体を継続的に監視・評価するプロセスが整うため、性能の劣化や予期せぬバイアスの発生といった問題の兆候を迅速に察知できます。

これにより、深刻なシステム障害だけでなく、企業の評判低下やコンプライアンス違反といった、経営上の重大なリスクを未然に防げます。

4.社内の意識向上、人材確保

全社的なAIガバナンスの推進は、従業員のAIリテラシーと倫理意識を高めます。

AI倫理を重視する企業文化は、自社の技術が社会に与える影響を深く考える優秀な専門家にとって大きな魅力です。

このような企業姿勢は、質の高いAI人材の採用競争において明確な優位性となり、長期的な人材確保につながります。

5.AI開発の標準化

組織全体のAI開発プロセスを標準化し、効率化できることも大きな利点です。

共通のルールやガイドラインを設けることで、開発の属人化を防ぎ、AIの品質を一定に保つことができます。

さらに、部門間の重複作業といった非効率をなくし、組織全体で一貫した方針のもと、開発スピードを高めることが可能です。

➡︎【資料ダウンロード】AI時代の未来を拓くAIエージェント導入の重要ポイント

AIガバナンスを導入する上での3つの課題と対策

AIガバナンスの導入には、技術面・組織面・社会面という3つの側面で課題があります。

こうした課題をあらかじめ把握し、適切な対策を講じることが、AI活用を成功へと導くポイントです。ここでは、それぞれの課題と乗り越えるための具体的なアプローチについて解説します。

1.技術的課題:判断プロセスの不透明性

技術面の最大の課題は、先に述べた、AIの判断プロセスが不透明になる「ブラックボックス問題」です。

この問題は公平性の検証を困難にするため、判断の根拠やプロセスを記録・検証できる仕組みを設計することが対策の基本となります。

また、学習データの品質を確保し、運用中の性能を監視するための技術的な仕組みの構築も同時に求められます。

2.組織的課題:経営層の理解と縦割り構造

組織面では、経営層の理解不足や部門間の縦割り構造が導入の障壁となりがちです。

この課題には、経営トップによる明確なコミットメントと、リーダーシップに基づく推進が欠かせません。

その上で、部門横断的な専門委員会を設置するなど、全社で一貫して取り組むための推進体制を構築することが有効な対策と言えるでしょう。

3.社会的課題:変化し続ける法規制

社会的な課題として、AIに関する法規制が国や地域によって異なり、さらに発展途上であることが挙げられます。

この不確実性に対しては、国内外の政府や業界団体の動向を常に注視し、変化に対応できるよう、自社のガバナンス体制を柔軟に見直し続ける姿勢が、最も重要な対策となるでしょう。

➡︎【資料ダウンロード】AI時代の未来を拓くAIエージェント導入の重要ポイント

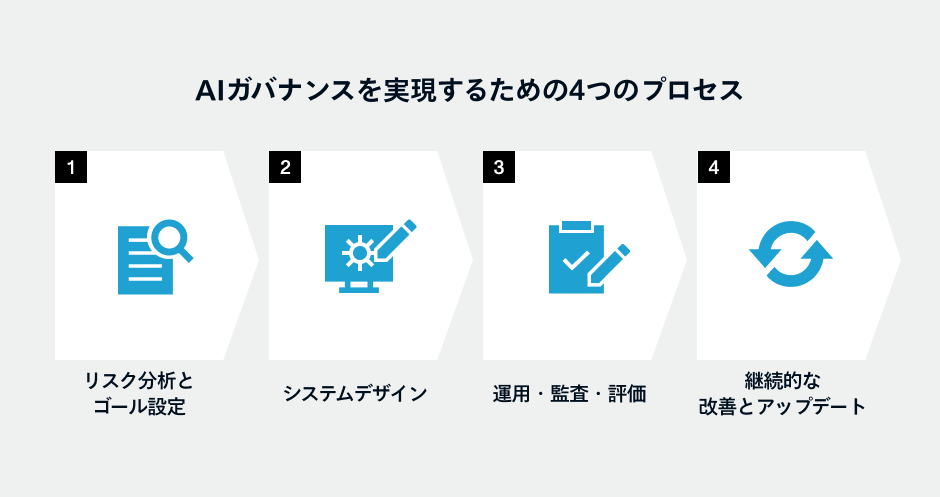

AIガバナンスを実現するための4つのプロセス

AIガバナンスを組織に根付かせるためには、場当たり的な対応ではなく、体系的かつ継続的なアプローチが必要です。

それは、一度ルールを作って終わりではなく、リスクの分析からシステムの設計、運用、そして改善まで、一連のサイクルを継続的に回し続ける活動だと言えます。

ここでは、AIガバナンスを効果的に実現するための具体的な手順を、4つのプロセスに分けて解説します。自社で取り組む際のロードマップとしてご活用ください。

1.リスク分析とゴール設定

最初のステップは、自社のビジネスにおいてAIがどのように利用されているか、また将来的にどのように利用されるかを棚卸しすることから始まります。

その上で、それぞれの活用シーン(ユースケース)で想定されるリスクを、倫理的、法的、技術的、社会的な観点から多角的に洗い出します。

たとえば、個人情報を扱うAIであればプライバシー侵害のリスク、採用AIであれば差別的判断のリスクなどが考えられるでしょう。

これらのリスク分析に基づき、自社が目指す「責任あるAI」の理想像を明確にし、「公平性を担保する」「透明性を確保する」といった具体的な目標(ゴール)を設定することが重要です。

2.システムデザイン

次に、設定したゴールを達成するための具体的な仕組み(システム)を設計します。

これには、守るべきルールを明文化した「AI倫理指針」や「開発ガイドライン」を策定することが含まれます。

同時に、それらのルールが確実に守られるような組織体制を構築することも不可欠だと言えるでしょう。

AIガバナンスを統括する責任者や専門委員会を設置し、各部門の役割と責任を明確にします。このシステムは、AIの企画・開発から運用、監視、廃棄に至るまで、ライフサイクル全体を網羅するように設計することで、一貫性のあるガバナンスを実現できます。

3.運用・監査・評価

設計したガバナンスの仕組み(システム)を実際の業務プロセスに実装し、運用を開始します。

ここで重要なのは、ルールが形骸化しないように、その遵守状況を継続的にモニタリングし、評価する仕組みを整えることです。

AIモデルのパフォーマンスや判断結果が、設定した公平性や安全性の基準を満たしているかどうかを、定期的な監査によって客観的に検証します。

この監査は、内部の専門チームが行うだけでなく、第三者機関による客観的な評価を取り入れることも信頼性を高める上で有効です。

監査結果は経営層に報告され、次の改善アクションにつなげる必要があります。

4.継続的な改善とアップデート

AIガバナンスは、一度構築したら完成というものではありません。AI技術は日々進化し、関連する法規制や社会的な要請も変化し続けます。

そのため、監査や評価の結果、あるいは外部環境の変化を踏まえ、ガバナンスの仕組み自体を常に見直し、改善していくPDCAサイクルを回すことが非常に重要です。

たとえば、新たなAI技術が登場すれば、それに伴うリスクを再評価し、ガイドラインを更新する必要があるでしょう。

こうした継続的な改善とアップデートを通じて、AIガバナンスは常に実効性を保ち、企業の持続的な成長を支える強固な基盤となるのです。

➡︎【資料ダウンロード】AI時代の未来を拓くAIエージェント導入の重要ポイント

まとめ:AIガバナンスで築く、未来への信頼と成長

AIガバナンスは、単なるリスク管理のための守りの施策にとどまりません。

AIという強力な技術と社会が共生し、企業が持続的に成長するための積極的な戦略基盤としての性質が強くあります。

本記事で解説したように、成功のカギは、倫理・法務・技術といった多角的な視点からAIのライフサイクル全体を統制する、包括的な仕組みを構築することにあります。

こうした取り組みは企業の社会的信頼と評判を高め、競争優位性の源泉となり得るのです。

そして何より、経営層の強いコミットメントのもと、全社的かつ継続的に実践できる組織体制を確立することが不可欠と言えるでしょう。

AIの社会への実装が加速するこれからの時代において、AIガバナンスに真摯に取り組む企業こそが、社会からの信頼を勝ち取り、真の価値を創造していくことができると考えます。

➡︎【資料ダウンロード】AI時代の未来を拓くAIエージェント導入の重要ポイント

モンスターラボはAI導入を支援する伴走型パートナー

モンスターラボでは、世界各国のスペシャリストがチームを組み、さまざまな業界・業種のデジタルサービス/プロダクト開発から、UX/UIデザイン、ブランド開発、グロースハックまで幅広く支援しています。

ビジネスの上流工程からデジタル領域の知見を持つコンサルタントが中心となり、課題に合わせたソリューションを提案します。さらに、先端テクノロジーを含むあらゆるプラットフォームに対応できる開発体制を整えています。その他にも、アジャイル開発による柔軟な開発進行や、国内外のリソースを活用したスケーラブルな開発体制の構築、リリース後の保守運用や品質向上支援まで、さまざまなニーズに対応しています。

さらに、世界各国の拠点とネットワークを活かし、お客様のビジネスの海外展開も支援しています。対象地域におけるビジネス立案から現地調査まで、これまで培ったグローバルな支援実績をもとに伴走支援します。

モンスターラボが提供するサポートの詳しい概要は以下リンクをご確認ください。